Eliezer Yudkowsky

| Eliezer Yudkowsky | ||

|---|---|---|

| ||

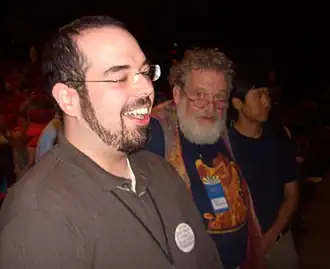

Eliezer Yudkowsky in 2007

| ||

| Algemene informatie | ||

| Geboren | 11 september 1979 | |

| Nationaliteit(en) | Amerikaans | |

| Beroep(en) | auteur | |

| Bekend van | kunstmatige intelligentie | |

| Website | https://www.yudkowsky.net/ | |

Eliezer Shlomo Yudkowsky (geboren op 11 september 1979) is een Amerikaanse auteur over beslissingstheorie en ethiek. Hij is medeoprichter en onderzoeker bij het Machine Intelligence Research Institute (MIRI), een non-profit onderzoeksinstituut, gevestigd in Berkeley (Californië).

Yudkowsky is vooral bekend om zijn popularisering van ideeën over “vriendelijke” kunstmatige intelligentie. Zijn werk over het vooruitzicht van een op hol geslagen intelligentie-explosie beïnvloedde filosoof Nick Bostroms boek “Superintelligence: Paths, Dangers, Strategies”.[1][2]

Zie ook

Bronnen, noten en/of referenties

- Dit artikel of een eerdere versie ervan is een (gedeeltelijke) vertaling van het artikel Eliezer Yudkowsky op de Engelstalige Wikipedia, dat onder de licentie Creative Commons Naamsvermelding/Gelijk delen valt. Zie de bewerkingsgeschiedenis aldaar.

- ↑ ISBN 978–0–19–967811–2.

- ↑ (en) Paul Ford, Our Fear of Artificial Intelligence. MIT Technology Review (11 februari 2015). Gearchiveerd op 30 maart 2019. Geraadpleegd op 30 maart 2019.